No es la primera vez que alguien señala las vulnerabilidades del sistema Autopilot de Tesla. Recientemente un equipo de investigadores japoneses mostraba varios fallos de esta tecnología y ahora hace lo propio un conductor, que ha publicado un vídeo en su cuenta de Twitter en el que se ve como un Model S circula de forma autónoma con el conductor sentado en el asiento de atrás.

Y aunque las imágenes no parecen estar trucadas, el capítulo con el Model S y su maletero que se inunda con la lluvia nos ha demostrado que no siempre un vídeo publicado en Redes Sociales puede convertirse en una prueba fehaciente de un fallo…

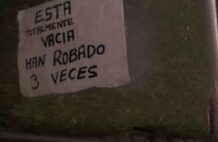

El protagonista del vídeo tuvo una genial ocurrencia: se preguntó si el Autopilot de su Tesla Model S podría ser engañado si colocaba una botella de café adherida al volante mediante una pinza.

People are really stupid / this is why we can’t have nice things / WTF?! / Darwin at work pic.twitter.com/wU91HENOQH

— 🦄🦄🦄🦄🦄🦄🦄 (@Jason) 3 de abril de 2019

Y tal y como se puede ver en el vídeo, así fue. Mientras el conductor se tumbaba en la bancada trasera, el coche eléctrico seguía circulando autónomamente sin hacer advertencia alguna ni detenerse, dos acciones para las que el sistema supuestamente está preparado en caso de detectar que no hay nadie al volante.

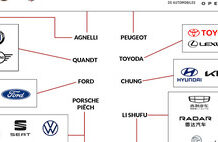

Este nuevo capítulo se suma a anteriores, como los de los investigadores de Tencent Keen Security Lab, que demostraron que el Model S podía ser confundido por otras marcas en la carretera que no fueran señales viales y que permitía ser conducido desde un mando de Xbox, o el del cargo público californiano Alexander Samek que, estando borracho, se quedó dormido al volante también de un Model S sin que el sistema lo detectara.

Aunque en comparación a estos dos últimos casos, el que nos ocupa tiene varias lagunas…

Si el Autopilot tarda 15 segundos en avisar, ¿por qué el vídeo dura sólo diez?

Y es que esta ‘prueba’ en forma de vídeo hay que cogerla con pinzas, ya que hay ciertas cosas que chirrían. Teóricamente, en las últimas versiones del Autopilot de Tesla, concretamente en la 2019.5.25 según detalla en este vídeo Saúl López, vicepresidente de Tesla Owners Spain, esta tecnología detecta si se está realizando o no presión sobre el volante.

De no hacerlo durante un tiempo máximo de 15 segundos, el sistema alerta a conductor y, de no percibir presión pasados unos segundos, el coche acaba por echarse a un lado y detenerse por completo. Según López el Autopilot es muy eficaz en este aspecto, obligando a, al menos, mantener una mano sobre el volante aplicando el peso necesario (que no puede ser tampoco excesivo) para evitar que salte la alarma.

[embedded content]

Y aunque bien es cierto que el conductor habría podido burlar el sistema, ya que la botella pinzada al volante (parece que de medio litro) ejerce cierto peso sobre el volante, es llamativo que el vídeo únicamente dure diez segundos. Es decir, no pasan los 15 segundos de rigor que demostrarían que, efectivamente, el Autopilot no detecta que el conductor no está a los mandos.

Además hay que tener en cuenta que esta tecnología de conducción semiautónoma de Tesla, en sus últimas versiones avisa de inactividad en cualquier circunstancia una vez se rebasen los 10 km/h, por lo que queda fuera de este supuesto que no lo haga, ya que en el cuentakilómetros puede verse que circula a más de 100 km/h.

Así que, si realmente el Autopilot no detectó en este caso que no había conductor, ¿por qué no continuar cinco segundos más para demostrar que el sistema estaba fallando? Puede que fuera mera torpeza del automovilista o puede que estemos ante otro de los muchos haters que busca desprestigiar a Tesla. Y si así fuera, hay que estar muy loco para jugarse la vida de esta manera…